过去三个月,从深圳腾讯大厦的排队长龙,到某鱼上标价数百乃至数千元的“代养虾”服务,基于OpenClaw部署的"数字员工"已成为2026年开年最魔幻的互联网景观。许多人一边让通过OpenClaw运行的AI Agent接管工作流,一边在被问及"它到底是什么"时,会下意识地回到那个模糊的原点:这种模糊,在技术语境中正是“AI Agent”与“Agentic AI”的混淆——前者是执行特定任务的技术实体,后者是跨系统编排的系统能力,但在中文语境下都被简称为“智能体”。在个人场景中,这种认知偏差的代价或许是“好不好用”;而在工业场景中,它会被迅速放大——你以为是在引入一个提效工具,实际却在改变流程结构、决策路径,甚至系统边界。你究竟是在部署一个可以执行任务的工具(AI Agent),还是在构建一个具备目标驱动与协同能力的系统(Agentic AI)?这个区分,不只是概念问题,而是会直接影响系统设计方式、落地路径,乃至最终的业务结果。

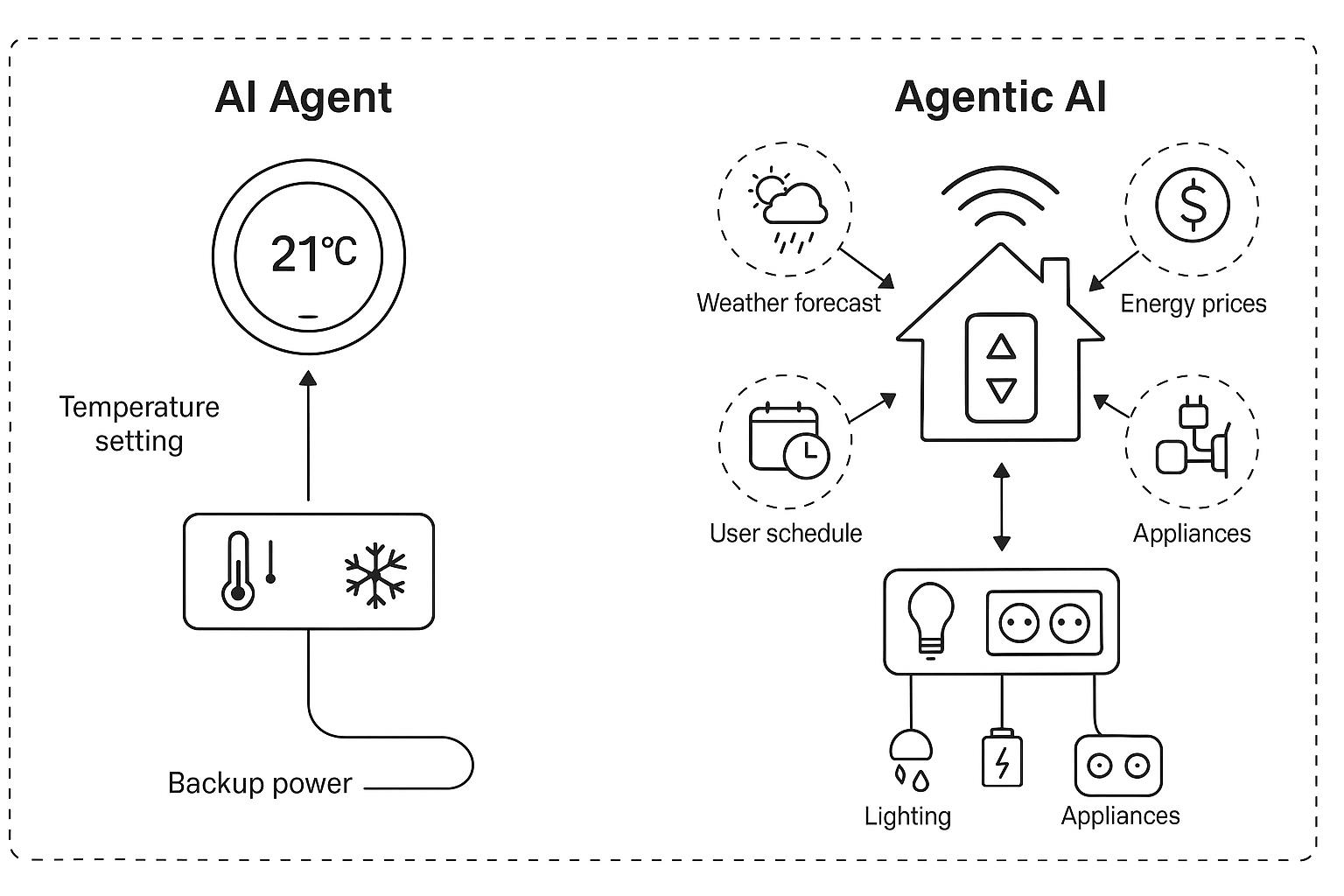

【图源:《AI Agents vs. Agentic AI》 by Sapkota et al. 2025》】

混淆AI Agent与Agentic AI的边界,直接导致两种昂贵的错误:用单点工具硬撑复杂跨职能流程,造成自动化碎片化;或为简单任务过度部署复杂系统,浪费资源的同时增加治理风险。

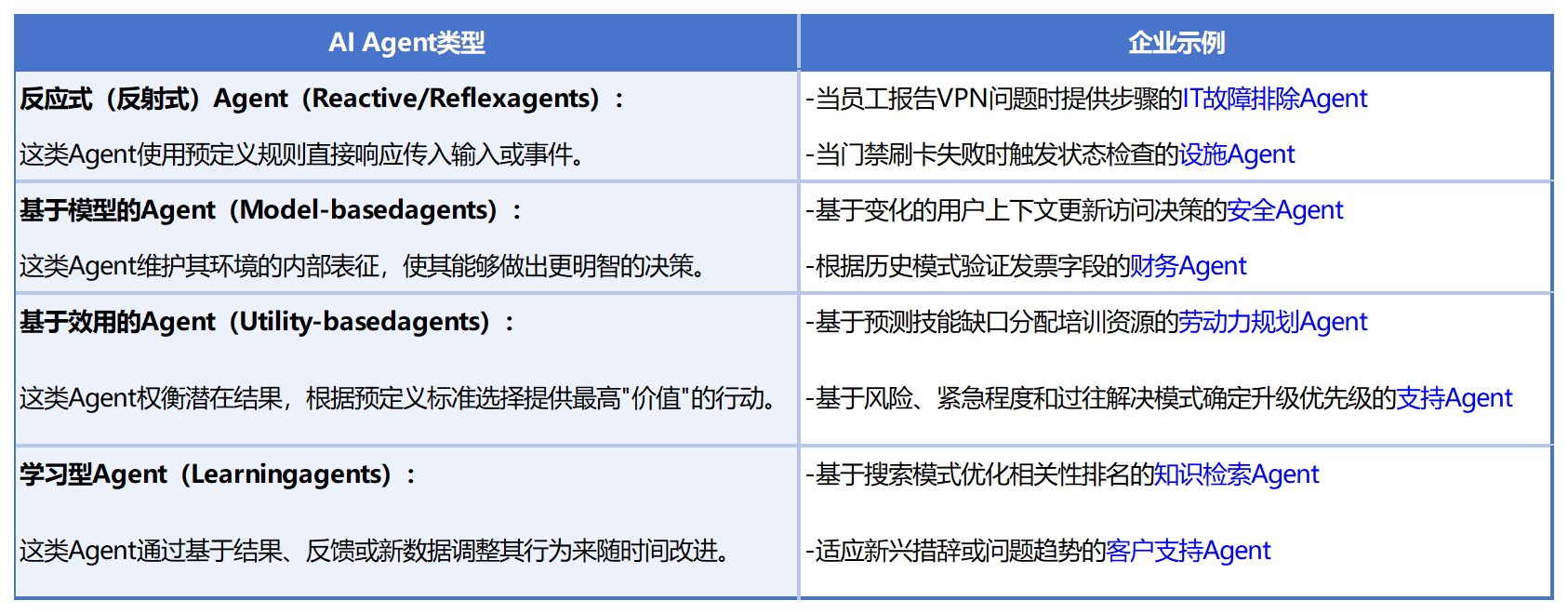

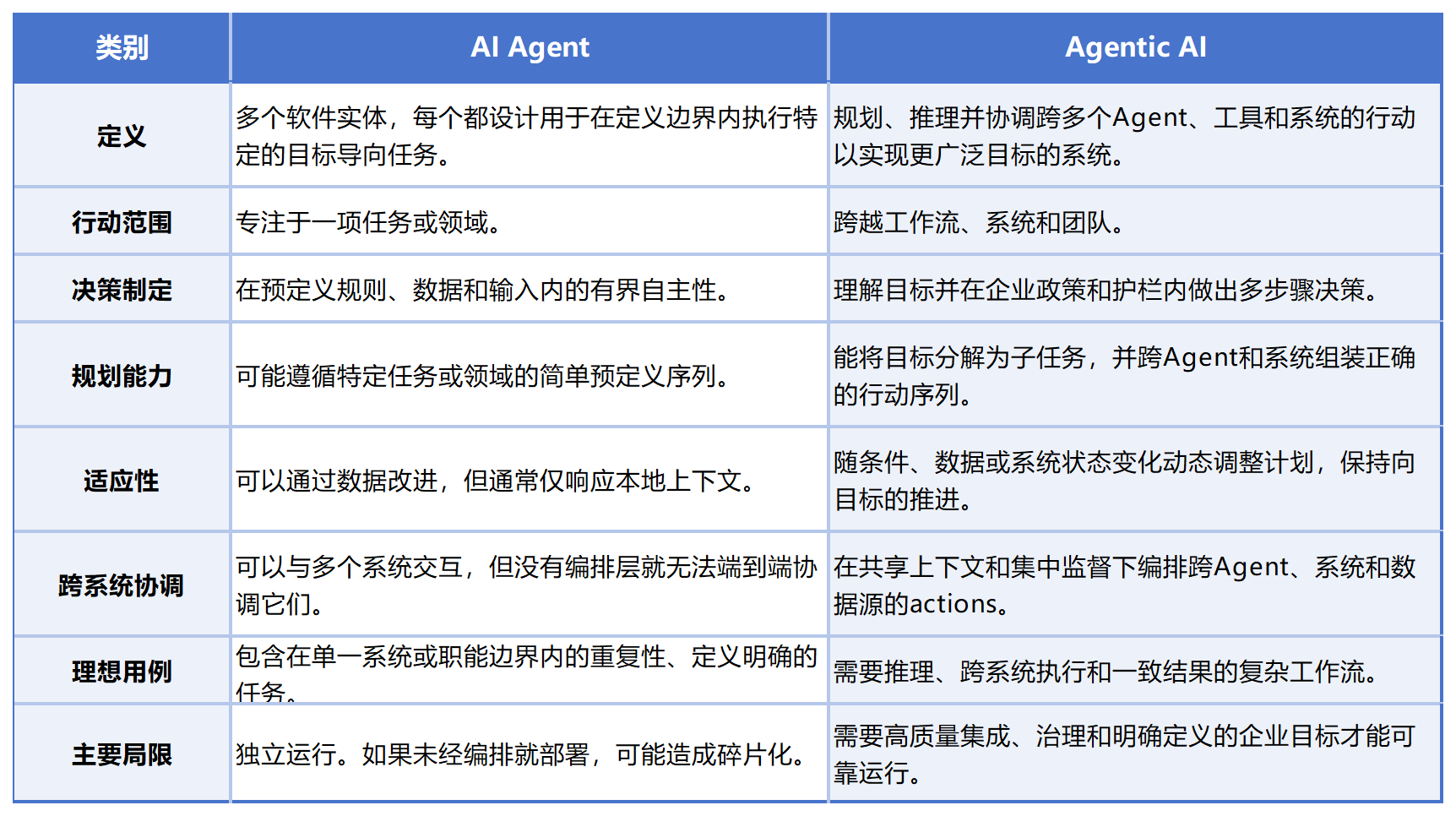

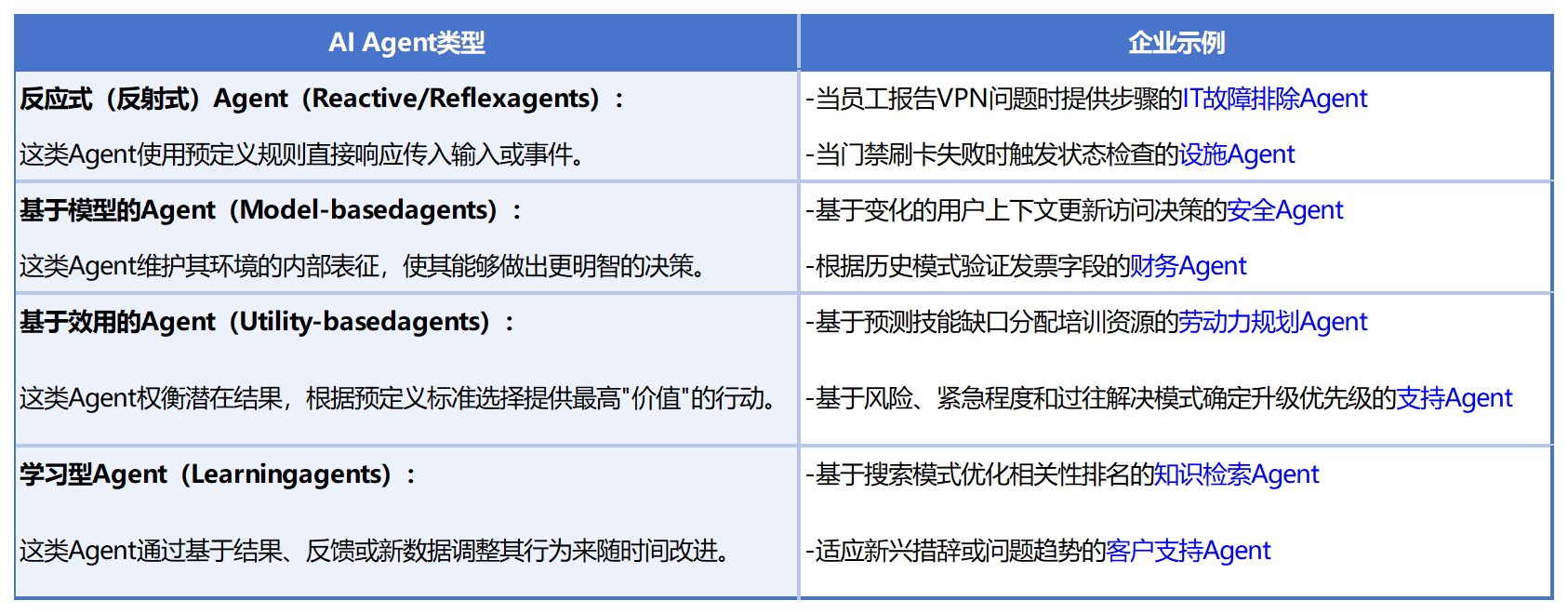

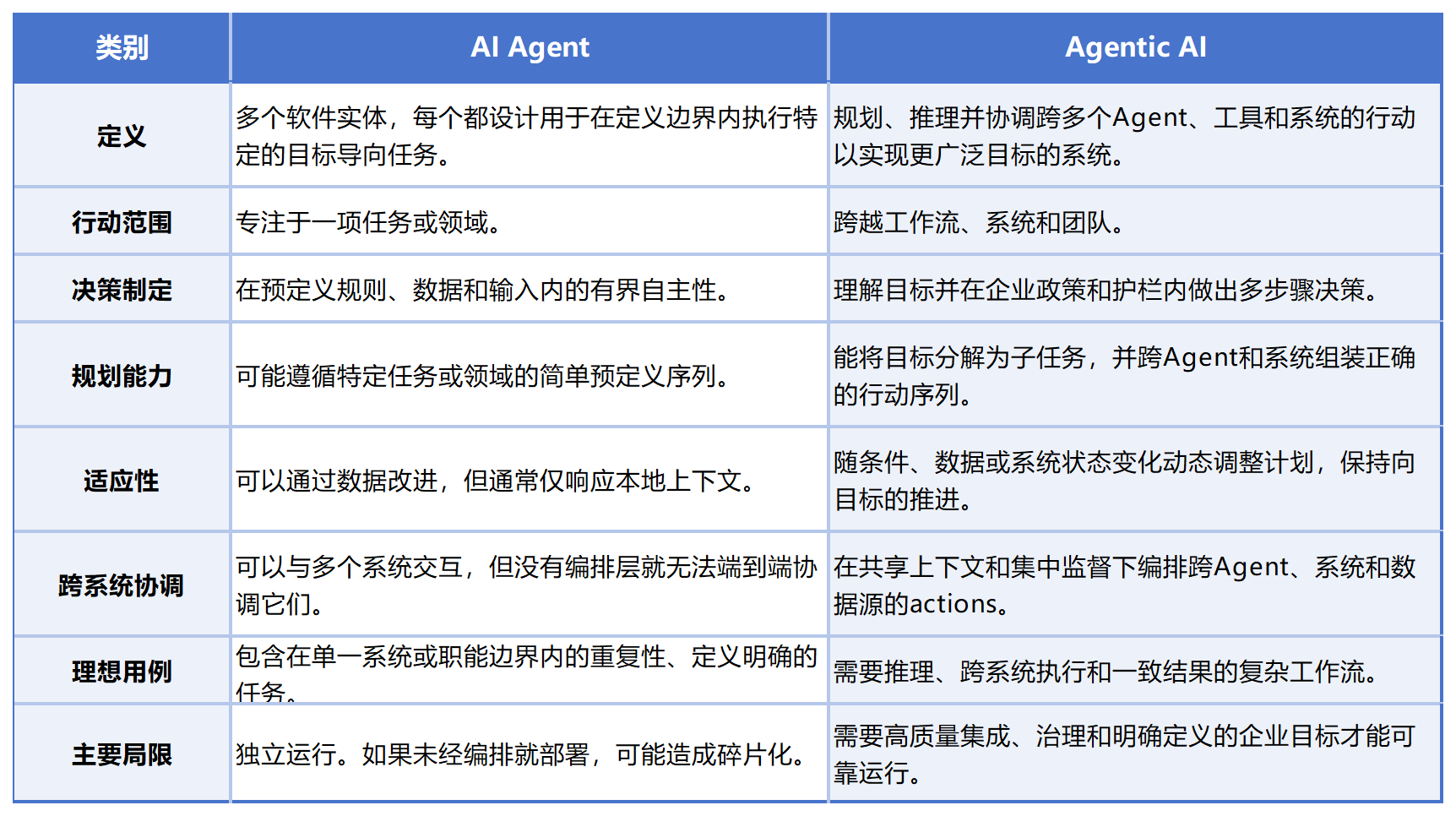

它是基于大模型构建的软件实体,能在明确边界内自主完成特定任务——从CRM中检索客户记录、验证发票字段、过滤邮件优先级,到根据规则重置密码。它具备基础工具调用能力,能直接查询数据库、调用API获取实时数据,但仅限于完成其特定的单一任务。它的核心特征是"有界自主":在预设范围内,它能感知、推理并行动,但跳出这个范围,它既不会主动扩展目标,也无法记住跨会话的历史。

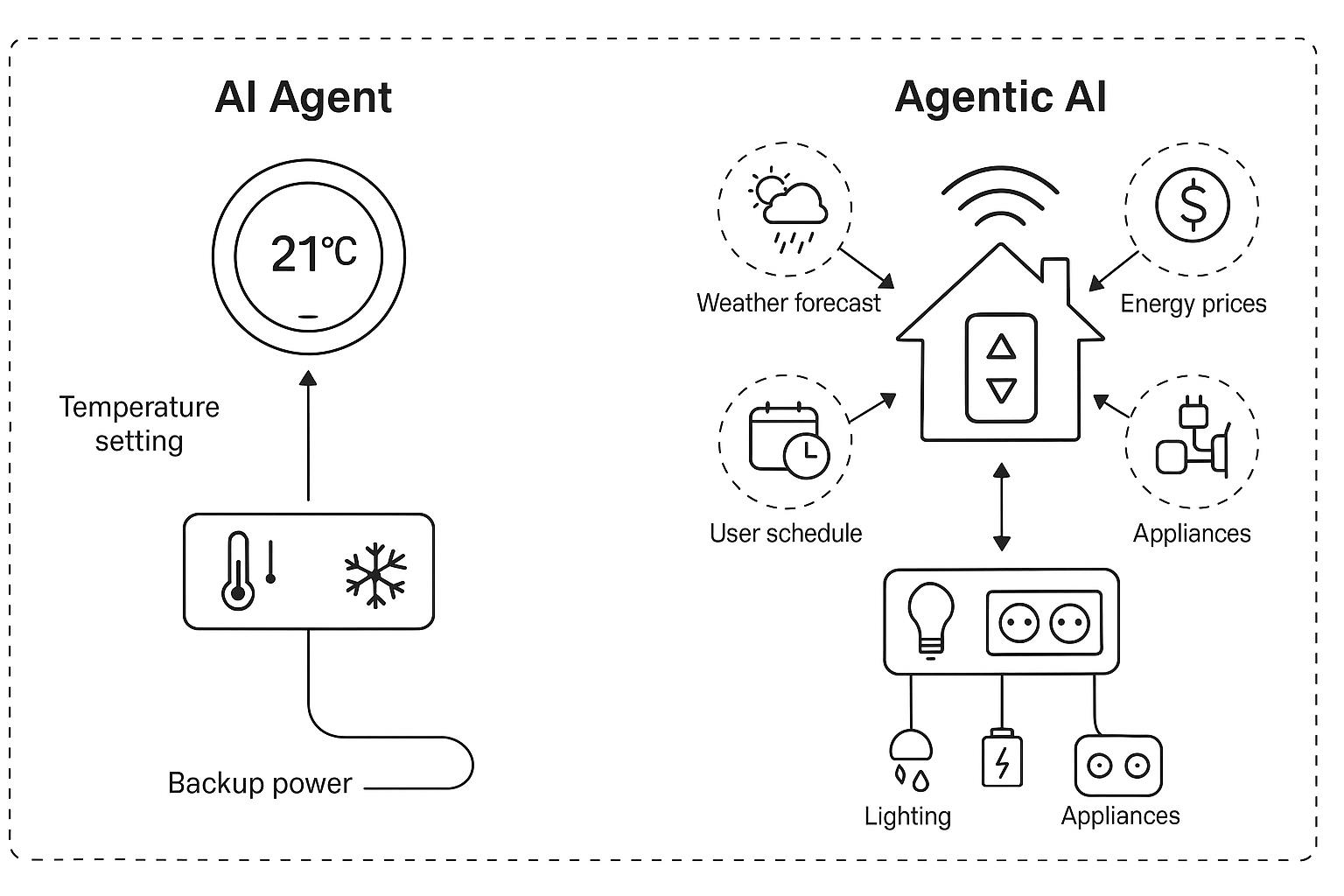

打个比方,一个智能温控器就是典型的AI Agent。你设定21℃,它自主调节加热或制冷来维持温度,甚至能学习你的作息规律。但它不会与天气预报、电价波动或安防系统互动。每次交互都是独立的"无状态"过程:上一次对话的内容不会自动延续到这一次,除非人工重新输入上下文。它不再满足于完成单个任务,而是致力于交付完整业务成果。想象上述的智能温控器进化为一整套智能厂房管理系统:气象Agent预测明日寒潮,能源Agent计算电价低谷时段,生产Agent调整排产计划,安防Agent在无人时启动巡逻模式——这些专业Agent通过协调中枢共享数据、同步决策,共同实现"在保证舒适的前提下最小化能耗"这一系统目标。AI Agent在任务层面运作,Agentic AI在结果层面运作。前者是乐手,后者是指挥家加整个乐团。当然,拥有多个AI Agent并不意味着拥有Agentic AI——如果没有统一的编排层来维护共享上下文、管理任务依赖和处理异常,100个Agent只是100个独立的自动化孤岛,而非一个有机系统。

理解两者的技术差异,不需要深入代码,但需要理解三个关键的工程逻辑转变。它依赖提示中的上下文窗口理解当前任务,就像一次性把说明书全部摊在桌上,看完后全部收走,下次从零开始。这限制了它处理长周期事务的能力——即使具备短期工具调用能力,它也无法在跨会话的长时间跨度中保持策略一致性。它通过外部向量数据库、共享内存缓冲区,将交互历史(情景记忆)、领域知识(语义记忆)和检索数据(向量记忆)沉淀下来。但这不仅仅是"存储"的问题——记忆必须与递归规划能力配合。比如说,当供应链Agent在第十步发现原材料短缺时,它不仅能回溯到第三步的供应商选择逻辑(记忆功能),更能基于这一历史信息动态调整后续十步的计划(规划功能),而不是机械地继续执行已失效的指令。AI Agent遵循预定义序列或简单的"思考-行动"循环(如ReAct框架):它能处理"如果A则B"的线性流程,使用工具获取实时信息完成特定动作,但面对"在保证交付前提下,根据实时路况、设备状态和优先级动态调整生产排程"这类开放式目标时,就会陷入僵硬的规则匹配。面对复杂目标,系统中的规划Agent(或称Meta-Agent)会先将其拆解为可并行的子任务:一个Agent监控设备健康,一个Agent计算物流成本,一个Agent评估交期风险。更关键的是,当突发状况出现——比如某条产线突然故障——协调中枢能实时重规划,将任务重新分配给备用产能,并协调相关Agent同步更新工具调用策略(如让采购Agent立即查询备用供应商库存),而非等待人工介入。这种协调不是简单的消息转发。康奈尔大学的研究指出,成熟的Agentic系统需要A2A(Agent-to-Agent)协议,确保不同厂商、不同框架的Agent能用结构化语言交换中间结果,避免"鸡同鸭讲"的通信失效。三是工具调用的层级,从"独立使用"到"协调编排"。AI Agent具备单点工具调用能力:它能自主决定调用哪个API、查询哪个数据库来完成其特定任务。Agentic AI则在此基础上增加了协调层级的工具管理:编排层负责跨Agent分配工具使用权,避免资源竞争并支持工具链的组合。

对于制造业和工业运营,两者的分界不是技术优劣,而是问题本身的结构特征。

- 任务定义明确且封闭:如自动填充工单字段、从ERP中提取标准报表、根据固定规则分类质检图像;

- 保持在单一系统边界内:如仅在CRM内操作,不跨人事、财务、物流系统;

- 决策遵循明确规则:如"温度超过80℃触发报警",无需权衡多目标冲突;

- 无需长期记忆与跨步规划:每次任务独立,不涉及基于历史经验的策略调整。

典型案例:工厂中的设备监测Agent

它按预设路线读取传感器数据(独立调用设备API),对比阈值,超标时生成告警。它高效、可靠、可预测,能自主完成单点检测任务,但不会主动询问"为什么这周轴承温度持续偏高",也不会联动生产计划调整排班——这些需要跨系统协调和基于历史趋势的递归推理。

选择Agentic AI的场景特征:

- 跨多系统、多职能协调:如新产品导入(NPI)涉及研发、采购、生产、质检、物流的同步调整;

- 需要动态适应变化:如供应链中断时,自动寻找替代供应商、重新计算物流路径、调整生产优先级;

- 目标之间存在冲突需权衡:如需在多重约束(如成本、交期、质量)下权衡优化;

- 需要长期状态维护与策略调整:如持续三个月的工程项目,需保持决策连续性,并能基于累积经验优化后续规划。

典型案例:电信基础设施Agentic网络验证系统

当网络运维工程师提交设备配置变更请求时,系统并非直接投入生产环境,而是触发多Agent协同验证流程:助理Agent首先解析变更请求的技术意图;影响分析Agent在详细的数字孪生环境中模拟该变更对现网的影响;测试规划Agent基于风险评估 pinpoint 需验证的具体场景;测试执行Agent则在虚拟沙盒中自动应用提议的变更并运行形式化验证。这些Agent作为集成团队协同工作,在"指挥者"的协调下完成从意图解析、风险模拟到正式验证的全流程。

AI Agent的风险是单点失效

某个脚本出错,影响限于当前任务,修正后重启即可。它的治理简单:审计单一路径,明确责任边界。由于Agent间共享内存和通信,一个Agent的"幻觉"(错误输出)会作为输入传递给下游Agent,导致"以讹传讹"的错误放大。更严重的是涌现行为——当数十个Agent并行运作,可能产生设计者未预期的群体行为,如资源死锁、竞争条件或策略共谋。- 状态管理风险:有状态系统意味着数据持久化,需考虑数据隐私(如跨部门的敏感生产数据共享)和版本控制(Agent基于过时记忆做决策)。

- 责任分散问题:当质量事故源于多个Agent的协同决策,传统的"单点问责"失效,需要建立"数字审计追踪",记录每个Agent的决策路径和输入输出。

- 治理架构设计:工业级Agentic系统需要"治理感知架构"——通过角色隔离限制每个Agent的权限边界(如财务Agent不能访问设备控制指令),在关键节点设置"检查点",如超过一定金额的合同变更必须人工审批。

正如微软CEO萨提亚·纳德拉在达沃斯论坛所警示的:"世界正在凝聚共识:我们需要新技术,需要设立护栏,更需要规范其部署的准则。"对于工业场景,这意味着在享受自主性带来的效率之前,必须先建立可审计性、权限管理和故障熔断机制。

厘清AI Agent与Agentic AI的边界,不是为了在技术词典中增加两个注脚,而是为了在下单"数字员工"之前,先问自己:我究竟要一个能自动填表的高效助理,还是要一个能重构工作流程的协调中枢?

在工业数字化的深水区,只有带着这种区分意识去部署,才能避免把新工具装进旧流程的陷阱,真正实现从"试点游戏"到"规模应用"的跨越。毕竟,技术的终极价值不在于它多像人,而在于它是否让人更明智地工作。而对于工业数字化负责人来说,务实的路径是:先用AI Agent解决明确的单点痛点,建立对自动化技术的信任与数据基础;再识别那些因跨部门协调不畅而长期存在的流程瓶颈,引入Agentic AI进行系统性重构。若您正在规划相关方向,或希望厘清不同技术路径的适用边界,欢迎私信交流具体情境,我们愿意分享更多一线观察。

关注【科瑞斯达】官方公众号,了解更多前沿资讯及落地经验